Xiaomi opracowała model AI z 4,7 miliardami parametrów, łączący percepcję wizualną, mowę i sterowanie dla robotów.

Xiaomi wchodzi na rynek robotyki

Chiński gigant urządzeń mobilnych i inteligentnego domu, znany jako Xiaomi, ogłosił kolejny krok: opracowanie własnego modelu sztucznej inteligencji dla robotów. Firma zaprezentowała Xiaomi‑Robotics‑0, system open-source łączący rozpoznawanie wizualne, zrozumienie języka i kontrolę działań w czasie rzeczywistym. Model liczy 4,7 miliarda parametrów i już ustanowił kilka rekordów zarówno w symulacjach, jak i w praktyce.

Jak działa model

Robot zazwyczaj przechodzi cykl „postrzeganie → decyzja → działanie”. Xiaomi‑Robotics‑0 balansuje między szerokim zrozumieniem sytuacji a precyzyjnym sterowaniem motoryką dzięki architekturze Mixture‑of‑Transformers (MoT).

1. Model wizualno-językowy (VLM) – „mózg” systemu.

* Nauczył się interpretować polecenia, nawet rozmyte („proszę ułóż ręcznik”).

* Rozumie relacje przestrzenne na podstawie wysokiej jakości obrazów.

* Zadania: wykrywanie obiektów, odpowiadanie na pytania wizualne i logiczne wnioskowanie.

2. Ekspert ds. działań (Action Expert) – generator ruchów.

* Opiera się na transformatorze dyfuzyjnym (DiT).

* Nie generuje pojedynczego działania naraz; tworzy sekwencję działań poprzez dopasowywanie przepływów, co zapewnia płynność i precyzję.

Uczenie bez utraty zrozumienia

Zwykłe VLM tracą część swoich umiejętności percepcyjnych podczas uczenia się zadań fizycznych. Xiaomi rozwiązała ten problem, jednocześnie ucząc model multimodalnym danym (obrazy + tekst) i danymi o działaniach. Proces uczenia składa się z kilku etapów:

1. Propozycja działań – VLM przewiduje możliwe dystrybucje działań na obrazach, synchronizując wewnętrzną reprezentację z rzeczywistymi operacjami.

2. Następnie VLM „wyłącza się”, a DiT przechodzi oddzielne szkolenie generowania precyzyjnych sekwencji ze szumu, opierając się na kluczowych cechach, a nie na tokenach językowych.

Minimalizacja opóźnień

Aby wyeliminować przerwy między prognozami modelu a rzeczywistymi ruchami robota użyto asynchronicznego wydawania: obliczenia AI i działania robota są oddzielone. Pozwala to robotom poruszać się płynnie nawet przy konieczności dodatkowych obliczeń.

* Clean Action Prefix – metoda przywracania wcześniej przewidzianego działania, zapewniająca płynność bez skoków.

* Maskowanie uwagi skupia się na bieżącym wierszu wizualnym, ignorując wcześniejsze stany, co sprawia, że robot jest bardziej reaktywny na nagłe zmiany otoczenia.

Wyniki

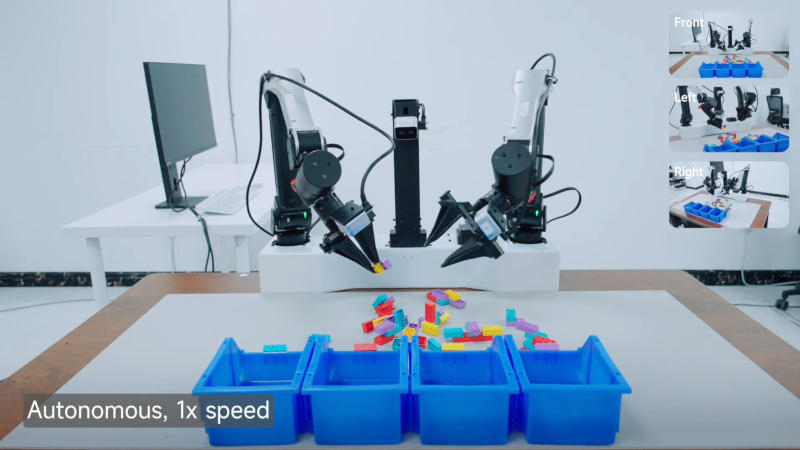

W środowiskach symulacyjnych LIBERO, CALVIN i SimplerEnv Xiaomi‑Robotics‑0 przewyższył około 30 konkurentów. Na rzeczywistym robocie z dwoma manipulatorami model skutecznie poradził sobie ze skomplikowanymi zadaniami: układanie ręczników, rozbiórka konstrukcji. Robot demonstrował stabilną koordynację rąk i oczu, równoważnie efektywnie manipulując obiektami w różnych scenariuszach.

W ten sposób Xiaomi nie tylko rozszerzyło swój portfel produktów, ale także zbudowało fundamenty dla dalszych badań w dziedzinie „fizycznej inteligencji” robotów.

Asted Cloud

Asted Cloud

Komentarze (0)

Podziel się swoją opinią — prosimy o uprzejmość i trzymanie się tematu.

Zaloguj się, aby komentować