Nvidia wypuściła chip Groq 3 LPU, który przyspiesza inferencję modeli AI do poziomu tokenów.

Nvidia ujawnia nowe możliwości platformy Vera Rubin

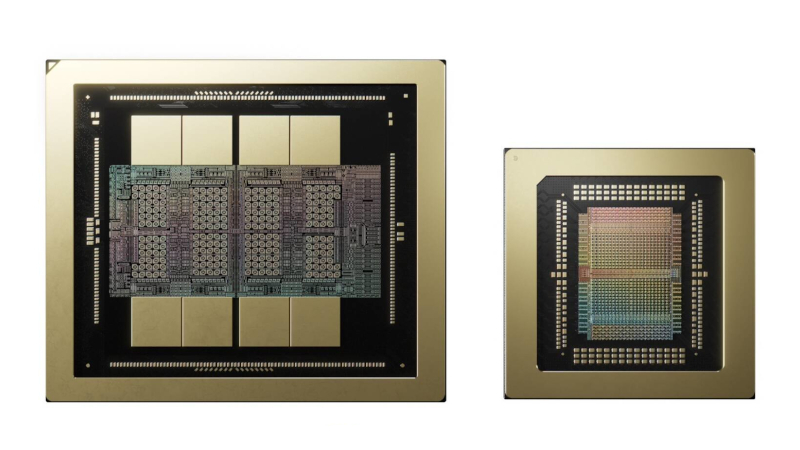

Na konferencji GTC tego roku dyrektor generalny Nvidia Jen-Hsun Huang ogłosił rozszerzenie platformy Vera Rubin. Podstawą nowych funkcji jest własność intelektualna nabyta od firmy Groq, a do Rubina włączono układ *Groq 3 LPU* – akcelerator inferencji zaprojektowany do wydawania tokenów z wysoką prędkością i niskim opóźnieniem.

Co już istnieje w Vera Rubin

Platforma składa się z sześciu kluczowych komponentów, które Nvidia łączy w systemy jednostkowe i skalibruje do dużych fabryk AI:

| Komponent | Opis |

|---|---|

| GPU Rubin | Karta graficzna z 288 GB HBM4 |

| CPU Vera | Centralny procesor |

| NVLink 6 | System wewnątrzsystemowego skalowania |

| ConnectX‑9 | Inteligentny adapter sieciowy BlueField‑4 |

| Spectrum‑X | Procesor przetwarzania danych |

| Kommutator intersystemowego skalowania z wbudowaną optyką |

Groq 3 LPU zostało dodane jako nowy blok konstrukcyjny, który będzie używany przy wdrażaniu dużych systemów.

Dlaczego Groq 3 LPU wyróżnia się

Główną różnicą jest architektura pamięci. Podczas gdy większość akceleratorów korzysta z HBM jako pamięci roboczej, każdy Groq 3 LPU zawiera 500 MB SRAM. Porównanie:

| Parametr | GPU Rubin (HBM4) | Groq 3 LPU (SRAM) |

|---|---|---|

| Pojemność | 288 GB | 0,5 GB |

| Przepustowość | ~22 TB/s | do 150 TB/s |

Dla zadań inferencyjnych wrażliwych na przepustowość korzyść SRAM jest oczywista. Dlatego Nvidia włączyła Groq 3 do Rubina – aby zwiększyć szybkość wydawania tokenów.

Stojak Groq 3 LPX

W stojaku znajduje się 256 układów Groq 3 LPU, co daje:

- 128 GB SRAM

- 40 PB/s sumarycznej przepustowości

- 640 TB/s interfejsu wewnątrzsystemowego

Wiceprezes ds. hipermaksymalnych rozwiązań Ian Buck nazwał ten stojak współprocesorem dla Rubina, podkreślając jego rolę w zwiększeniu wydajności dekodowania na każdym poziomie modelu i tokena.

Wpływ na systemy wieloagentowe

Buck zauważył, że Groq 3 LPX będzie kluczowym elementem przyszłego rynku AI – systemów wieloagentowych. Gdy agenci wymieniają dane bezpośrednio, a nie przez chatboty, wymagania dotyczące reakcji zmieniają się: od 100 tokenów/s do ponad 1 500+ tokenów/s i wyżej.

Konkurenci i perspektywy

W tekście wspomniano konkurenta – Cerebras, używający Wafer‑Scale Engine (WSE) z ogromnym SRAM dla niskolatencyjnej inferencji. OpenAI już wykorzystuje Cerebras w swoich zaawansowanych modelach dzięki korzystnemu opóźnieniu.

Buck również zauważył, że pojawienie się Groq 3 LPU może zmniejszyć zależność od akceleratora Rubin CPX. Obecnie Nvidia koncentruje się na integracji stojaka Groq 3 LPX z platformą, a oba układy mają wzmocnić inferencję bez konieczności dużych ilości pamięci GDDR7.

Wniosek:

Nowy układ Groq 3 LPU i jego stojak LPX wzmacniają Vera Rubin w segmencie niskolatencyjnej inferencji, otwierając drogę do szybszych systemów AI wieloagentowych i konkurowania z graczami takimi jak Cerebras.

Asted Cloud

Asted Cloud

Komentarze (0)

Podziel się swoją opinią — prosimy o uprzejmość i trzymanie się tematu.

Zaloguj się, aby komentować